图片海越互赢

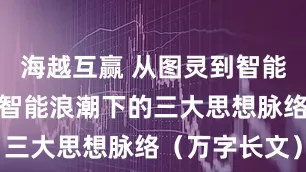

一、图灵的遗产与智能的梦想熟悉人工智能历史,才能更好的创造人工智能的未来!今天为大家梳理人工智能发展过程中的三大流派和对人工智能发展的影响和促进作用。

在计算机科学的黎明时期,英国数学家艾伦·图灵(Alan Turing)奠定了人工智能领域的理论基石。1950年,图灵在《思维》(Mind)杂志上发表了题为《计算机器与智能》的论文,提出了著名的'图灵测试',这一测试至今仍是衡量机器智能的重要参考。图灵大胆设想,如果机器能够在对话中使人类无法区分它与真实人类的差别,那么我们是否可以认为这台机器具备了'思考'的能力?

图片

图灵的远见卓识点燃了科学家们对机器智能的无限憧憬。在图灵去世后的1956年夏天,一场改变计算机科学历史进程的会议在美国新罕布什尔州的达特茅斯学院召开。这次会议由约翰·麦卡锡(John McCarthy)、马文·明斯基(Marvin Minsky)、克劳德·香农(Claude Shannon)和内森·罗切斯特(Nathan Rochester)等人发起,被后世称为'达特茅斯会议'。正是在这次会议上,'人工智能'(Artificial Intelligence)一词被麦卡锡首次提出并定义,标志着人工智能作为一个正式研究领域的诞生。

本文将以达特茅斯会议为起点,探索七十余年来人工智能发展的曲折历程。人工智能的研究并非沿着单一轨道线性发展,而是形成了多条并行且相互交织的思想脉络。本文将重点聚焦于三大主要派系的思想演变:符号主义(Symbolism)、连接主义(Connectionism)和行为主义(Behaviorism)。

符号主义强调通过符号操纵和逻辑推理来实现智能,它将大脑视为信息处理系统,认为思维过程可以用符号计算来模拟。连接主义则受到人脑神经网络结构的启发,主张智能源于大量简单单元的连接和并行计算,强调学习和适应的重要性。行为主义则另辟蹊径,强调智能是主体与环境交互的产物,智能体需要通过感知和行动在真实环境中学习和适应。

这三大派系各有优长,也各自经历了起伏跌宕的发展历程。它们之间既有竞争又有融合,共同推动了人工智能从理论到实践的不断突破。本文将系统梳理三大派系的核心理念、主要任务、关键成果及其局限性,最后探讨它们在现代人工智能研究中的融合趋势和未来发展方向。

二、符号主义的崛起与黄金时代1.符号主义的核心理念与方法

符号主义(也称为物理符号系统假说或计算主义)是人工智能早期的主导范式,由艾伦·纽厄尔(Allen Newell)和赫伯特·西蒙(Herbert Simon)在1976年正式提出。其核心观点是:智能可以通过对符号的操纵和逻辑推理来实现。符号主义者将人类思维视为一种符号处理过程,认为智能行为的本质是在符号结构上执行计算操作。这一理念深受逻辑学和认知心理学的影响,尤其是从形式逻辑和数理逻辑中汲取了丰富的思想资源。

在符号主义框架下,知识表示成为研究的核心环节。符号主义者发展了多种知识表示方法,包括基于规则的表示(如产生式规则)、框架(Frames)、语义网络(Semantic Networks)和谓词逻辑(Predicate Logic)等。这些表示方法各有特点:产生式规则适合表达因果关系;框架适合描述结构化的概念;语义网络擅长表示概念间的关联;谓词逻辑则提供了严格的推理机制。

图片

符号主义采用'自上而下'的知识驱动方法,即首先由专家明确定义知识和规则,然后系统基于这些预设的知识进行推理。这种方法强调显式知识的重要性,认为智能系统必须具备结构化的知识库和形式化的推理机制。符号主义的研究范式奠定了早期人工智能的基本框架,并在20世纪60年代至80年代的'认知革命'中发挥了重要作用。

2主要任务与关键成果

2.1 逻辑推理与定理证明

符号主义早期的重要突破是在逻辑推理和定理证明领域。1956年,艾伦·纽厄尔、赫伯特·西蒙和克利福德·肖(J. Clifford Shaw)开发了'逻辑理论家'(Logic Theorist)程序,这被认为是第一个人工智能程序。该程序能够证明《数学原理》(Principia Mathematica)中的部分定理,其中某些证明方法甚至比原书中的更为简洁,令数学家们惊叹不已。

在'逻辑理论家'的基础上,纽厄尔和西蒙于1957年开发了更为通用的'通用问题求解器'(General Problem Solver,GPS)。GPS的特点是将问题分解为子目标,并通过手段-目的分析(Means-Ends Analysis)来缩小当前状态与目标状态之间的差距。这一程序不仅能解决逻辑证明问题,还能应对塔问题(Tower of Hanoi)等经典智力挑战。GPS的设计理念对后来的人工智能规划和问题求解研究产生了深远影响。

图片

纽厄尔和西蒙因这些开创性工作被授予1975年的图灵奖,他们的研究不仅推动了人工智能的发展,也为认知科学提供了重要的理论框架。他们提出的'启发式搜索'概念成为解决复杂问题的基本方法,至今仍在各种智能系统中广泛应用。

2.2 专家系统

专家系统是符号主义人工智能的代表性成果,它试图模拟特定领域专家的知识和推理过程。专家系统通常由知识库(Knowledge Base)和推理引擎(Inference Engine)两部分组成。知识库包含领域专家的专业知识,通常以'如果-那么'(IF-THEN)规则的形式表示;推理引擎则根据知识库中的规则和用户提供的信息进行推理,得出结论或建议。

20世纪70年代至80年代,专家系统在多个专业领域取得了显著成功。1965年开发的DENDRAL系统能够根据质谱数据推断有机分子的结构,成为早期专家系统的成功典范。1972年开发的MYCIN系统专注于诊断血液感染并推荐抗生素治疗方案,其诊断准确率甚至超过了部分医学专家。其他著名的专家系统还包括用于地质勘探的PROSPECTOR、用于计算机配置的XCON等。

图片

在专家系统的发展中,约翰·麦卡锡的贡献不可忽视。他于1958年创造的LISP语言成为了早期人工智能研究的标准编程语言,其强大的符号处理能力和灵活的列表操作使之尤其适合实现推理系统和知识表示。麦卡锡不仅创造了'人工智能'一词,还在符号主义理论基础、非单调逻辑和常识推理等方面做出了重要贡献,被誉为'人工智能之父'。

2.3 自然语言处理的早期探索

自然语言处理是符号主义人工智能的另一个重要研究方向。早期的自然语言处理主要采用基于规则的方法,包括语法规则、语义规则和篇章规则等。这些系统试图通过形式化的语言规则来理解和生成自然语言。

在机器翻译领域,1954年的乔治城实验(Georgetown-IBM Experiment)展示了将俄语句子自动翻译成英语的可能性,虽然仅限于狭窄领域的简单句子。然而,早期机器翻译面临的困难远超预期,导致资金支持在1966年大幅削减,这一事件也成为人工智能第一次'寒冬'的组成部分。

在自然语言理解方面,约瑟夫·韦森鲍姆(Joseph Weizenbaum)于1966年开发的ELIZA程序是一个里程碑式的成果。ELIZA模拟心理治疗师与患者对话,通过模式匹配和简单的转换规则生成回应。尽管其内部机制相对简单,但ELIZA成功地给用户创造了'被理解'的错觉,许多人甚至向它倾诉内心秘密,这一现象后来被称为'ELIZA效应'。

罗杰·沙克(Roger Schank)的概念依存理论(Conceptual Dependency Theory)和脚本理论(Script Theory)提供了一种表示句子深层语义的方法,这些工作为理解自然语言的深层含义和上下文提供了理论框架。特里·温诺格拉德(Terry Winograd)的SHRDLU系统则展示了在受限环境(积木世界)中理解自然语言指令的可能性。

3 符号主义的局限性与挑战

尽管符号主义取得了显著成就,但在实际应用中也逐渐显露出一系列局限性。首先,符号主义在处理复杂、模糊和不确定性问题时表现不佳。真实世界充满不确定性和模糊性,很多问题难以用精确的符号和规则来描述。例如,自然语言的歧义性、视觉感知的模糊性等,都给符号主义方法带来了巨大挑战。

其次,知识获取成为符号主义的主要瓶颈,即所谓的'知识工程困难'(Knowledge Engineering Bottleneck)。构建专家系统需要领域专家和知识工程师长时间密切合作,将专家的隐性知识转化为显性的规则,这一过程耗时费力且效率低下。随着应用领域的扩大和复杂化,手工编码知识的局限性日益凸显。

图片

第三,符号系统缺乏'常识'和'背景知识'的问题尤为突出。人类在理解世界时依赖大量的常识和背景知识,这些知识对人类来说似乎是显而易见的,但要将其形式化并编码到计算机系统中却异常困难。马文·明斯基将这一挑战称为'常识问题'(Commonsense Problem),它至今仍是人工智能面临的重大挑战之一。

随着这些问题的积累,符号主义开始受到质疑,研究者们开始寻找替代方案,这为连接主义和行为主义的兴起创造了条件。然而,符号主义的基本思想及其在知识表示和推理方面的成果并未被完全否定,而是在后来的人工智能发展中以新的形式得到继承和发展。

三、连接主义的兴起与低谷1 连接主义的核心理念与方法

连接主义(Connectionism)是人工智能的另一重要流派,其核心理念受到人脑神经系统结构和功能的启发。连接主义主张智能来源于大量简单计算单元的连接和并行计算,而非符号操纵和逻辑推理。这一思想可追溯到20世纪40年代沃伦·麦卡洛克(Warren McCulloch)和沃尔特·皮茨(Walter Pitts)提出的形式神经元模型。

在连接主义框架下,人工神经网络成为研究的核心。人工神经网络由三个基本要素构成:神经元(或称节点、单元),它们执行简单的计算操作;连接(或称突触),它们将一个神经元的输出传递给其他神经元;以及权重,它们调节连接的强度。神经网络的学习机制主要通过调整这些连接权重来实现,例如赫布学习法则(Hebbian Learning)和反向传播算法(Backpropagation)。

连接主义采用'自下而上'的数据驱动方法,即神经网络通过大量示例数据进行学习,从而获取隐含在数据中的规律,而无需人为定义明确的规则。这一特点使连接主义方法特别适合处理模式识别、分类和预测等问题,尤其是在数据丰富但规则难以明确定义的领域。连接主义的研究范式与符号主义形成鲜明对比,开创了人工智能研究的新方向。

2 主要任务与关键成果

2.1 感知机与早期神经网络

连接主义的第一个重要里程碑是弗兰克·罗森布拉特(Frank Rosenblatt)于1958年提出的感知机(Perceptron)模型。感知机是一种简单的前馈神经网络,由输入层和输出层组成,能够学习线性可分的分类问题。罗森布拉特在康奈尔航空实验室开发了Mark I感知机,这是世界上第一台神经网络计算机,能够识别简单的视觉模式。感知机的成功引发了广泛关注,罗森布拉特乐观地预测感知机将来能够'走路、说话、看物体、写作、自我复制,并且意识到自己的存在'。

图片

与感知机几乎同时期,伯纳德·维德罗(Bernard Widrow)和马尔塞恩·霍夫(Marcian Hoff)于1960年开发了自适应线性元件(Adaptive Linear Element,ADALINE)及其扩展版本MADALINE(Multiple ADALINE)。ADALINE采用了一种新的学习算法——最小均方(Least Mean Square,LMS)算法,也称为维德罗-霍夫学习规则。这一算法在自适应滤波和信号处理领域取得了实际应用,例如电话线路的回波抵消。

这些早期神经网络模型虽然结构简单,但已展示出了连接主义方法在模式识别领域的潜力,为后续研究奠定了基础。它们不仅推动了理论的发展,也激发了对硬件实现神经计算的探索。

2.2 反向传播算法的突破海越互赢

反向传播算法(Backpropagation)的发展是连接主义历史上的关键突破。这一算法能够有效训练多层神经网络,克服了单层感知机无法解决非线性可分问题(如异或问题)的局限。反向传播算法的核心思想是通过计算损失函数对网络权重的梯度,然后沿梯度反方向调整权重,从而最小化网络的预测误差。

尽管反向传播算法的基本思想可追溯到20世纪60年代末和70年代初亨利·凯利(Henry J. Kelley)和阿瑟·布赖森(Arthur E. Bryson)等人的工作,但直到1986年杰弗里·辛顿(Geoffrey Hinton)、戴维·鲁梅尔哈特(David Rumelhart)和罗纳德·威廉姆斯(Ronald J. Williams)在《自然》(Nature)杂志上发表论文《学习表征的反向传播误差》,这一算法才得到广泛关注和应用。

辛顿等人的工作不仅重新发现并系统化了反向传播算法,还通过实验展示了多层神经网络在解决非线性问题上的强大能力。这一突破为连接主义的复兴奠定了理论和实践基础,也为21世纪深度学习的爆发式发展埋下了伏笔。

2.3 神经网络在模式识别领域的应用

在反向传播算法的推动下,神经网络在模式识别领域开始取得一系列实际应用。在图像识别方面,神经网络被用于手写数字识别、人脸识别和医学图像分析等任务。特别是,美国邮政服务采用了神经网络技术来自动识别邮件上的邮政编码,这是早期神经网络在大规模实际应用中的成功案例。

在语音识别领域,时间延迟神经网络(Time Delay Neural Network,TDNN)等模型展示了处理序列数据的能力。这些模型能够捕捉语音信号中的时间特征,为后来的语音识别技术发展奠定了基础。

金融领域也开始应用神经网络进行市场预测和风险评估。神经网络的非线性建模能力使其在处理金融市场的复杂模式时具有优势,尽管其预测的可靠性和可解释性仍存在争议。

尽管这些早期应用相对简单,但它们展示了神经网络在解决实际问题中的潜力,特别是在传统算法难以应对的模式识别和非线性建模领域。这些成功案例为后来深度学习的广泛应用积累了宝贵经验。

3 连接主义的第一次寒冬

尽管早期神经网络取得了一些成功,但连接主义很快就遭遇了严重挫折,进入了被称为'人工智能第一次寒冬'的低迷期。这一寒冬的主要触发因素是马文·明斯基(Marvin Minsky)和西摩·帕珀特(Seymour Papert)于1969年出版的《感知机》(Perceptrons)一书。

在这本书中,明斯基和帕珀特严谨地分析了单层感知机的数学性质,证明了它无法解决简单的异或(XOR)问题等非线性可分问题。这一理论证明对当时的神经网络研究产生了沉重打击。尽管他们的分析仅限于单层感知机,但由于当时多层神经网络缺乏有效的训练算法,这一批评被广泛解读为对整个连接主义方法的驳斥。

图片

除了理论挑战外,当时的计算能力限制也严重阻碍了连接主义的发展。20世纪60年代至70年代的计算机处理能力有限,存储空间昂贵,训练复杂神经网络需要的计算资源远超当时技术条件所能提供的范围。这一技术瓶颈使得即使在理论上可行的多层神经网络,在实践中也难以实现和验证。

资金支持的减少是寒冬的另一个表现。由于理论和实践上的困境,连接主义研究在20世纪70年代至80年代初期失去了大部分研究经费和学术关注,许多研究者转向其他研究方向,连接主义研究几乎陷入停滞。

然而,少数研究者如斯蒂芬·格罗斯伯格(Stephen Grossberg)和杰弗里·辛顿等人在这一困难时期仍坚持对神经网络的研究,为日后连接主义的复兴做出了重要贡献。特别是,自组织映射(Self-Organizing Maps)和自适应共振理论(Adaptive Resonance Theory)等模型在这一时期得到了发展,丰富了连接主义的理论基础。

四、行为主义的另辟蹊径1 行为主义的核心理念与方法

与符号主义和连接主义不同,行为主义(Behaviorism)或称为新行为主义(neo-behaviorism)开辟了人工智能研究的第三条道路。这一学派的核心理念是:智能本质上是主体与环境交互的产物,而非仅存在于抽象的符号操作或神经连接中。行为主义强调感知与行动的直接耦合,主张通过简单的刺激-反应机制可以产生看似复杂的智能行为。

行为主义的理论基础部分来自生物学和心理学的启发,特别是简单生物体如昆虫如何通过简单机制在复杂环境中生存的研究。这一学派认为,智能体需要在真实世界中通过感知和行动来学习和适应,而非在抽象的符号空间或连接模型中运作。

图片

行为主义引入了两个重要概念:具身智能(Embodied Intelligence)和情境认知(Situated Cognition)。具身智能强调身体结构对智能的重要性,认为思维不仅仅发生在大脑中,而是涉及整个身体与环境的互动;情境认知则强调智能行为总是嵌入特定环境中,与具体情境密不可分。

这一学派采用'自下而上'的、基于环境交互的方法,主张通过构建简单的反应式系统,然后在真实环境中测试和改进,逐步实现复杂的智能行为。这种方法与符号主义的抽象推理和连接主义的模式学习形成鲜明对比,为人工智能研究提供了全新视角。

2 主要任务与关键成果

2.1 基于规则的反应式系统

行为主义的早期探索集中在设计简单而有效的反应式系统。这些系统直接将感知输入映射到行动输出,无需复杂的内部状态表示或推理过程。威廉·格雷·沃尔特(William Grey Walter)在20世纪40年代末开发的'电子龟'(Machina Speculatrix)是这一思路的早期体现。这些机器人虽然内部机制极为简单,仅由几个传感器和电机组成,但能表现出趋光、避障等看似有目的的行为。

瓦伦丁·布拉滕伯格(Valentino Braitenberg)在其1984年的著作《器思:一种合成心理学》(Vehicles: Experiments in Synthetic Psychology)中设计了一系列简单机器人思想实验,展示了如何通过简单的感应-电机连接产生看似复杂的行为,如恐惧、攻击、爱和逻辑等。这些布拉滕伯格车(Braitenberg Vehicles)成为行为主义机器人设计的重要启发源。

这些简单系统的成功挑战了人工智能需要复杂内部表示的传统观念,证明了许多看似复杂的行为可能源于简单的反应式机制。这一发现为后续更复杂的行为主义系统奠定了基础。

2.2 包容架构与自主机器人

行为主义的重要突破来自罗德尼·布鲁克斯(Rodney Brooks)提出的包容架构(Subsumption Architecture)。布鲁克斯在1986年发表的论文《具有健壮智能的稳健分层控制》中批判了传统人工智能对内部表示的依赖,提出了'世界就是最好的模型'的口号,强调智能体应直接利用环境信息而非构建复杂的内部模型。

包容架构采用分层控制系统,每一层负责特定的行为能力(如避障、游走、探索等),高层行为可以抑制或修改低层行为的输出。这种设计实现了行为的优先级组织,使机器人能够在不同情境下表现出适当的行为。与符号主义系统的集中式控制不同,包容架构采用分布式控制,各行为模块相对独立运行,使系统更为健壮。

基于这一架构,布鲁克斯及其团队在麻省理工学院人工智能实验室开发了一系列名为'昆虫'(Insect)的六足机器人,如Genghis和Attila,它们能够在复杂地形上自主行走,表现出惊人的适应性。这些机器人无需详细的环境地图或复杂的规划算法,却能有效地导航和避障,颠覆了传统人工智能的设计理念。

2.3 BEAM机器人

BEAM(Biology, Electronics, Aesthetics, Mechanics)是马克·蒂尔登(Mark Tilden)在20世纪90年代开发的一种机器人设计哲学,深受行为主义思想影响。BEAM机器人强调使用简单的模拟电路而非复杂的数字处理器,通过神经元样电路(Nervous Networks或Nv nets)实现控制,并从生物系统中汲取设计灵感。

BEAM机器人的特点是利用最少的元件实现最大的功能性,强调硬件在环境适应中的作用,而非软件算法。这些机器人通常采用太阳能供电,能够表现出趋光、避障等行为,有些甚至具备简单的学习能力。尽管单个BEAM机器人的能力有限,但它们集体可以展现出复杂的群体行为,这种简单部件产生复杂整体的现象被称为“涌现”(Emergence)。

BEAM机器人不仅是行为主义原则的体现,也是一种教育工具和艺术形式,影响了后来的DIY机器人社区和生物启发式设计。蒂尔登的工作展示了在没有复杂规划和内部模型的情况下,如何通过简单的行为组合实现鲁棒的智能行为。

3 行为主义的优势与局限

行为主义方法在处理动态、不可预测的环境和实现基本的自主行为方面展现出独特的优势。其强调与环境的直接交互,使得智能体能够快速适应变化,无需预先构建详尽的世界模型。包容架构和BEAM机器人的成功案例证明了简单机制可以产生复杂的行为,这为设计低成本、高鲁棒性的机器人提供了新的思路。

然而,行为主义也存在明显的局限性。由于缺乏抽象的内部表示和推理能力,行为主义方法在处理需要复杂规划、知识推理和高层次认知任务时显得力不从心。例如,行为主义机器人很难理解复杂的指令、进行抽象概念的推理或解决需要长期规划的问题。此外,行为主义的研究往往侧重于特定的行为和环境,难以推广到更广泛的领域。

尽管如此,行为主义的思想为人工智能研究提供了重要的补充视角,强调了智能的“具身性”和“情境性”,并影响了后来的强化学习和机器人学等领域。

五、连接主义的复兴与深度学习革命1 连接主义的再次崛起

尽管在20世纪70年代末遭遇寒冬,但连接主义并未完全沉寂。少数研究者坚持在神经网络领域深耕,并在理论和技术上取得了一些重要的进展。20世纪80年代,随着计算能力的提升和一些关键算法的突破,连接主义迎来了第二次发展浪潮。

其中,最关键的突破是杰弗里·辛顿、戴维·鲁梅尔哈特和罗纳德·威廉姆斯等人对反向传播算法的重新发现和推广。这一算法解决了训练多层神经网络的难题,使得构建更深、更复杂的网络成为可能。此外,循环神经网络(Recurrent Neural Networks, RNNs)的发展也为处理序列数据(如文本和语音)提供了新的工具。

然而,这一时期的神经网络仍然面临着一些挑战,例如梯度消失问题和训练数据的缺乏。尽管如此,连接主义在模式识别、函数逼近等领域取得了一些初步成功,为未来的发展奠定了基础。

2 深度学习的关键技术与模型

21世纪初,随着计算能力的飞速发展(特别是GPU的广泛应用)和大规模数据集的出现,连接主义迎来了真正的爆发,深度学习应运而生,并在人工智能的多个领域取得了革命性的突破。

2.1 卷积神经网络 (CNNs)

卷积神经网络(Convolutional Neural Networks, CNNs)在图像识别领域取得了里程碑式的成就。由扬·立昆(Yann LeCun)等人提出的CNNs通过模拟生物视觉系统的结构,利用卷积层、池化层等特殊结构有效地提取图像的局部特征,并具有良好的平移不变性。

2012年,由杰弗里·辛顿的学生Alex Krizhevsky等人提出的AlexNet在ImageNet图像识别大赛中以压倒性的优势获胜,标志着深度学习在计算机视觉领域的巨大成功。随后,涌现了VGG、ResNet、Inception等更深、更复杂的CNN模型,不断刷新图像识别的精度,并在人脸识别、物体检测、图像分割等任务中得到广泛应用。

2.2 循环神经网络 (RNNs) 与长短期记忆网络 (LSTMs)

循环神经网络(Recurrent Neural Networks, RNNs)专门用于处理序列数据。与前馈神经网络不同,RNNs具有循环连接,能够将先前的信息传递到后续的计算中,从而捕捉序列数据中的时序依赖关系。

然而,传统的RNNs在处理长序列数据时容易出现梯度消失或梯度爆炸的问题。为了解决这个问题,Sepp Hochreiter和Jürgen Schmidhuber等人提出了长短期记忆网络(Long Short-Term Memory Networks, LSTMs)。LSTMs引入了记忆单元和门控机制,能够有效地学习和记忆长距离的依赖关系,在自然语言处理(如机器翻译、文本生成、情感分析)和语音识别等领域取得了重大突破。约书亚·本吉奥在RNNs和注意力机制方面也做出了重要贡献。

2.3 注意力机制 (Attention Mechanisms) 与 Transformer 模型

注意力机制(Attention Mechanisms)的提出进一步提升了神经网络处理序列数据的能力。注意力机制允许模型在处理序列的每个位置时,动态地关注输入序列中相关的部分,从而更好地捕捉上下文信息。

2017年,谷歌提出了基于自注意力机制的Transformer模型,彻底改变了自然语言处理领域。Transformer模型摒弃了传统的循环结构,完全依赖于注意力机制进行序列建模,具有并行计算能力强、能够捕捉长距离依赖等优点。基于Transformer的模型(如BERT、GPT系列)在机器翻译、文本生成、问答系统等任务上取得了前所未有的成功。

2.4 生成对抗网络 (GANs) 与其他深度学习模型

除了上述模型外,深度学习还涌现了许多其他重要的模型和技术,例如生成对抗网络(Generative Adversarial Networks, GANs),它由Ian Goodfellow等人提出,通过生成器和判别器的对抗训练,能够生成逼真的图像、音频和视频等数据。自编码器(Autoencoders)和变分自编码器(Variational Autoencoders, VAEs)在无监督学习和数据降维方面也发挥着重要作用。

3 深度学习在各个领域的广泛应用

深度学习的突破性进展使其在人工智能的各个领域都得到了广泛应用,并取得了令人瞩目的成就:

计算机视觉:图像识别、物体检测、图像分割、视频分析、人脸识别等。

自然语言处理:机器翻译、文本生成、情感分析、文本分类、问答系统、对话系统等。

语音识别:语音转文本、语音合成等。

推荐系统:个性化推荐、广告投放等。

游戏:AlphaGo在围棋上战胜人类顶级棋手,以及在其他复杂游戏中的出色表现。

医疗健康:疾病诊断、药物发现、基因组学等。

金融:风险评估、欺诈检测、量化交易等。

自动驾驶:环境感知、路径规划、车辆控制等。

深度学习的成功标志着连接主义的全面复兴,并引领了人工智能发展的新时代。

六、融合与未来展望1 三大派系的相互借鉴与融合

尽管符号主义、连接主义和行为主义在历史上曾被视为相互竞争的学派,但随着人工智能的不断发展,研究者们逐渐认识到不同方法的优势和局限,并开始探索将它们相互借鉴和融合的可能性。

例如,神经符号人工智能(Neuro-Symbolic AI)旨在将神经网络的强大模式识别能力与符号主义的逻辑推理能力相结合。这种方法试图构建能够进行复杂推理、具有良好可解释性,并且能够利用先验知识的智能系统。知识图谱作为一种结构化的知识表示形式,常常与深度学习模型结合使用,以提升模型的性能和可解释性。

在自然语言处理领域,一些研究尝试将基于规则的符号方法与基于神经网络的统计方法相结合,以提高语言理解和生成的准确性和鲁棒性。在机器人学领域,一些研究者探索将行为主义的反应式控制与基于模型的规划相结合,以实现更灵活和智能的自主行为。

这种融合的趋势表明,未来的人工智能系统可能会更加复杂和多样化,能够根据不同的任务和场景选择最合适的策略和方法。

2 当前人工智能面临的挑战与机遇

尽管人工智能取得了巨大的进步,但仍然面临着许多重要的挑战:

可解释性(Explainability):深度学习模型通常被认为是“黑箱”,难以理解其决策过程,这在一些高风险领域(如医疗和金融)是一个重要的障碍。

鲁棒性(Robustness):深度学习模型在面对对抗性攻击或与训练数据分布不同的新数据时,性能可能会急剧下降。

公平性(Fairness):训练数据中的偏见可能会导致人工智能系统做出不公平或歧视性的决策。

通用人工智能(Artificial General Intelligence, AGI):目前的人工智能系统在特定任务上表现出色,但距离具备人类水平的通用智能还有很长的路要走。

常识推理(Commonsense Reasoning):让机器具备人类的常识和背景知识仍然是一个巨大的挑战。

与此同时,人工智能也面临着巨大的发展机遇:

更强大的感知能力:随着传感器技术和算法的进步,人工智能系统将能够更准确、更全面地感知世界。

更复杂的推理能力:通过结合不同的人工智能方法,未来的系统将能够进行更复杂的逻辑推理、规划和问题求解。

更自然的交互方式:人工智能将能够以更自然、更智能的方式与人类进行交互,例如通过更流畅的自然语言对话和更智能的人机界面。

更广泛的应用领域:人工智能将在医疗、教育、交通、制造等各个领域发挥越来越重要的作用,推动社会经济的发展。

3 结论:智能的探索永无止境

回顾人工智能的发展历程,从图灵的设想到达特茅斯会议的召开,再到符号主义的兴起、连接主义的沉浮、行为主义的探索,以及最终深度学习的崛起,我们可以看到,人类对智能的探索从未停止。符号主义、连接主义和行为主义这三大派系的思想相互碰撞、相互借鉴,共同塑造了今天的人工智能 landscape。

尽管我们已经取得了显著的成就,但实现真正的通用人工智能仍然是一个遥远的目标,未来的道路上充满了挑战和机遇。随着技术的不断进步和新的理论的出现,我们有理由相信,人工智能将在未来继续取得突破,为人类社会带来更加智能、便捷和美好的生活。智能的探索永无止境,而我们正处于这场伟大旅程的激动人心的时刻。

(全文完)

好了,今天就分享这些。

文章较长,建议收藏后稍后再看海越互赢,希望对你学习和理解AI有帮助!

本站仅提供存储服务,所有内容均由用户发布,如发现有害或侵权内容,请点击举报。策利配资提示:文章来自网络,不代表本站观点。